Для облегчения рутинной работы по сбору информации, предназначен простой парсер сайтов - Scraper. Парсер Scraper – это расширение для браузера Chrome с ограниченными функциями парсинга данных, но оно будет полезно многим для анализа и экспорта данных в Google Spreadsheets.

Этот простой парсер данных, предназначен как для новичков, так и для экспертов, которые могут легко скопировать данные в буфер обмена или хранилище в виде электронных таблиц, используя OAuth.

Парсер достаточно простой, в нем нет полной автоматизации или поисковых ботов, как у других инструментов, но это можно рассматривать даже как преимущество, особенно для новичков, поскольку его не нужно подолгу настраивать, чтобы получить в итоге нужный результат.

Scraper работает прямо в браузере и автоматически генерирует XPaths для поиска URL, которые нужно передать. Xpath — это язык запросов к элементам xml или xhtml документов. Чтобы получить нужные данные, необходимо создать запрос, описывающий эти данные. Остальную работу выполнит интерпретатор языка xpath. Для тех, кто захочет познакомиться с Xpath поближе — есть учебник XPath.

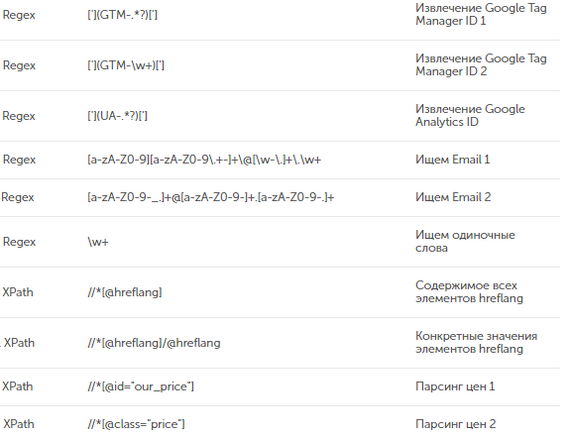

Некоторые примеры использования Xpath для парсинга информации с сайтов

- Текст заголовка h1 — //h1/text ()

- Текст ссылки — //a/text ()

- URL значение атрибута href ссылки — //a/@href

- Изображение src — //img/@src

Чтобы найти XPath элемента на странице необходимо:

- Перейти на нужную страницу

- Выделить элемент и щелкнуть по нему правой кнопкой мыши

- В открывшемся окне выбрать пункт «Просмотреть код»

- В открывшейся консоли выделить элемент мышкой и нажать правую кнопку мыши

- В открывшемся меню выбрать пункт «Copy» и «Copy XPath»

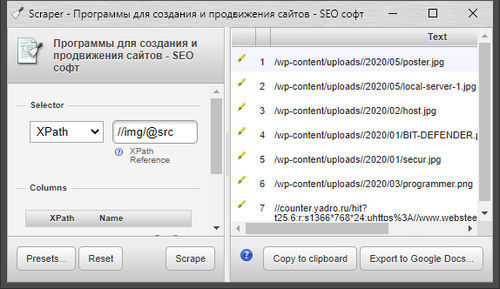

Работа парсера Scraper

После загрузки расширения откройте нужный вам сайт, выделите требуемую область страницы с данными, которые нужно собрать.

Затем щелкните правой кнопкой мыши, вы увидите параметр с названием «Scrape similar» (Собрать похожие). Щелкните по пункту «Scrape similar».

Откроется окно парсера, в котором вы увидите извлеченное содержимое в виде таблицы.

В разделе «Selector» можно выбрать, какие элементы страницы будут извлекаться. Вы можете указать запрос как селектор jQuery или в XPath.

Вы можете экспортировать данные, нажав “Export to Google Docs” (экспорт в Google Документы), чтобы загрузить и сохранить содержимое в виде таблицы Google. Также вы можете настроить столбцы таблицы и указать имена для них. После настройки необходимо нажать кнопку «Scrape» (Сбор данных), чтобы обновить результаты таблицы.

Ниже рассмотрим некоторые примеры использования парсера для сбора данных, которые могут пригодиться при работе с сайтами.

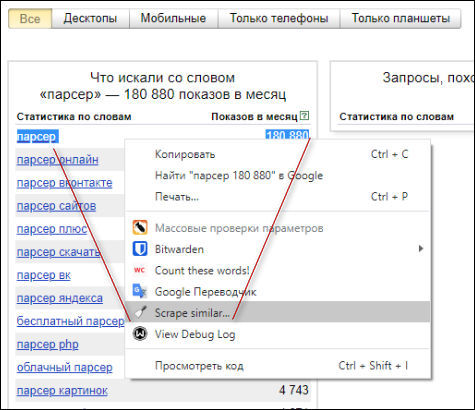

- Работает как парсер ключевых слов вордстата

Заходим на сайт Яндекс.Вордстат. Выбираем если нужно регион. Вводим ключ и нажимаем «Подобрать».

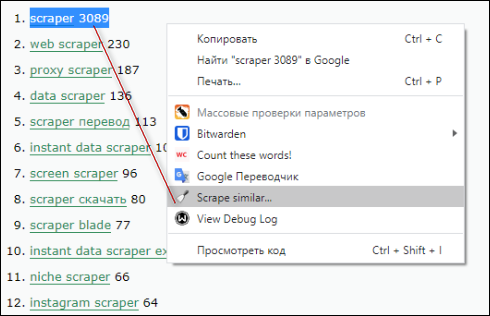

Далее выделяем мышкой два заголовка таблицы «Статистика по словам» и «Показов в месяц». Нажимаем правой кнопкой мыши на любом выделенном столбце и в контекстном меню выбираем «Scrape similar», как показано на скриншоте. Откроется окно парсера с результатами которые можно сохранить где вам удобно.

- Работает как парсер ключевых слов сервиса Мутаген

Работает аналогично вордстат. Выделяем мышкой первый результат и нажимаем «Scrape similar».

- Еще одна из возможностей, это парсинг ссылок с карты сайта, меню и рубрик. Работает аналогично.

Также нужно отметить, что этот простой парсер используется для простых и средних задач и для данных которые находятся на одной странице.